OpenCode Ollama Gemma4 Test

지난번 글1 지난번 글2 에서 qwen3-coder 와 glm-4.7 를 테스트 해 보고 처참한 결과를 내었는데, 이번엔 Gemma 4 다

Gemma4 는 총 4개의 모델이 로컬에서 사용 가능하도록 공유되어 있다

- gemma4:e2b

- gemma4:e4b

- gemma4:26b

- gemma4:31b

이번에는 3090 하나가 원래 PC 로 돌아가 있어서, 다시 끼우기가 귀찮기에 3090 한개만 가지고 시도 하기로 한다.

31b 로는 메모리가 좀 오버할거 같아 26b 로 테스트 하기로 했다. 다른 모델들과 다르게 파라메터 사이즈가 큰 차이가 나지 않아 성능 차이도 크지 않을것이라 판단 햇다.

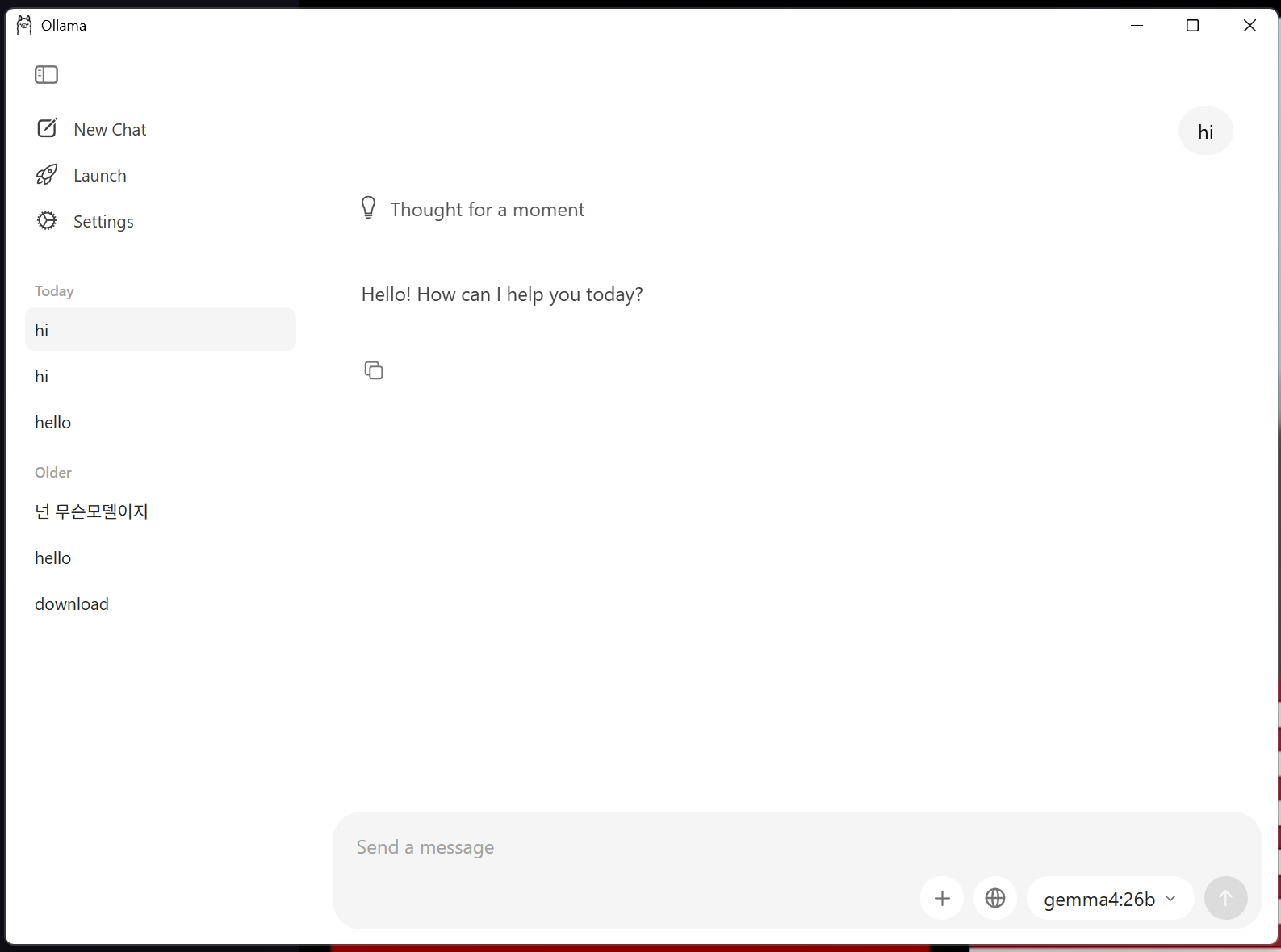

목록에 자동으로 안뜨지만, 모델 저장소에 없는건 아니라서 이전글 처럼 단순히 모델명을 붙여넣고 아무 이야기나 하면 자동적으로 다운로드가 진행된다

지난번 글을 참고하여 Model 도 등록했다(qwen3과 glm4.7 은 더이상 안 쓰기에 제거했다)

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

{

"$schema": "https://opencode.ai/config.json",

"model": "ollama/gemma4:26b",

"plugin": [

],

"provider": {

"ollama": {

"npm": "@ai-sdk/openai-compatible",

"name": "Ollama (local)",

"options": {

"baseURL": "http://localhost:11434/v1"

},

"models": {

"gemma4:26b": {

"name": "Gemma 4 26B"

}

}

}

}

}

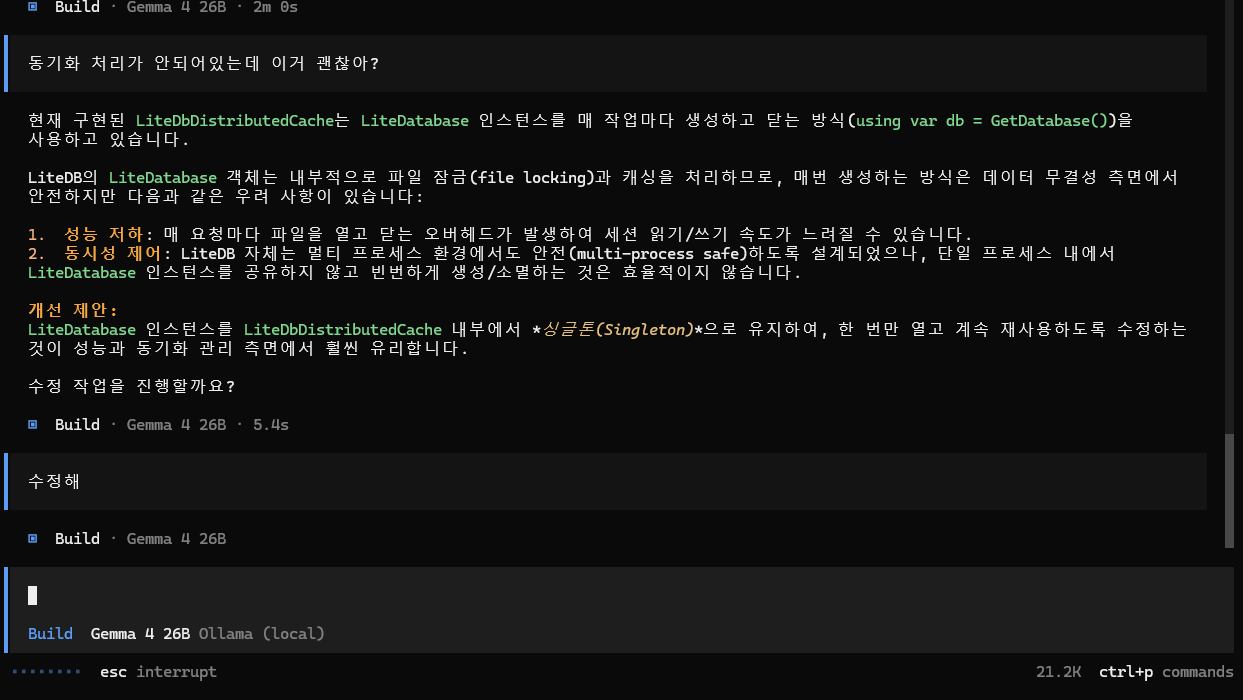

간단한 테스트를 했더니…. 어? 뭔가 되는거 같다…? 그래서 간단한 것들을 좀 더 시켜봤다

생각보다 무난히 잘 해 낸다

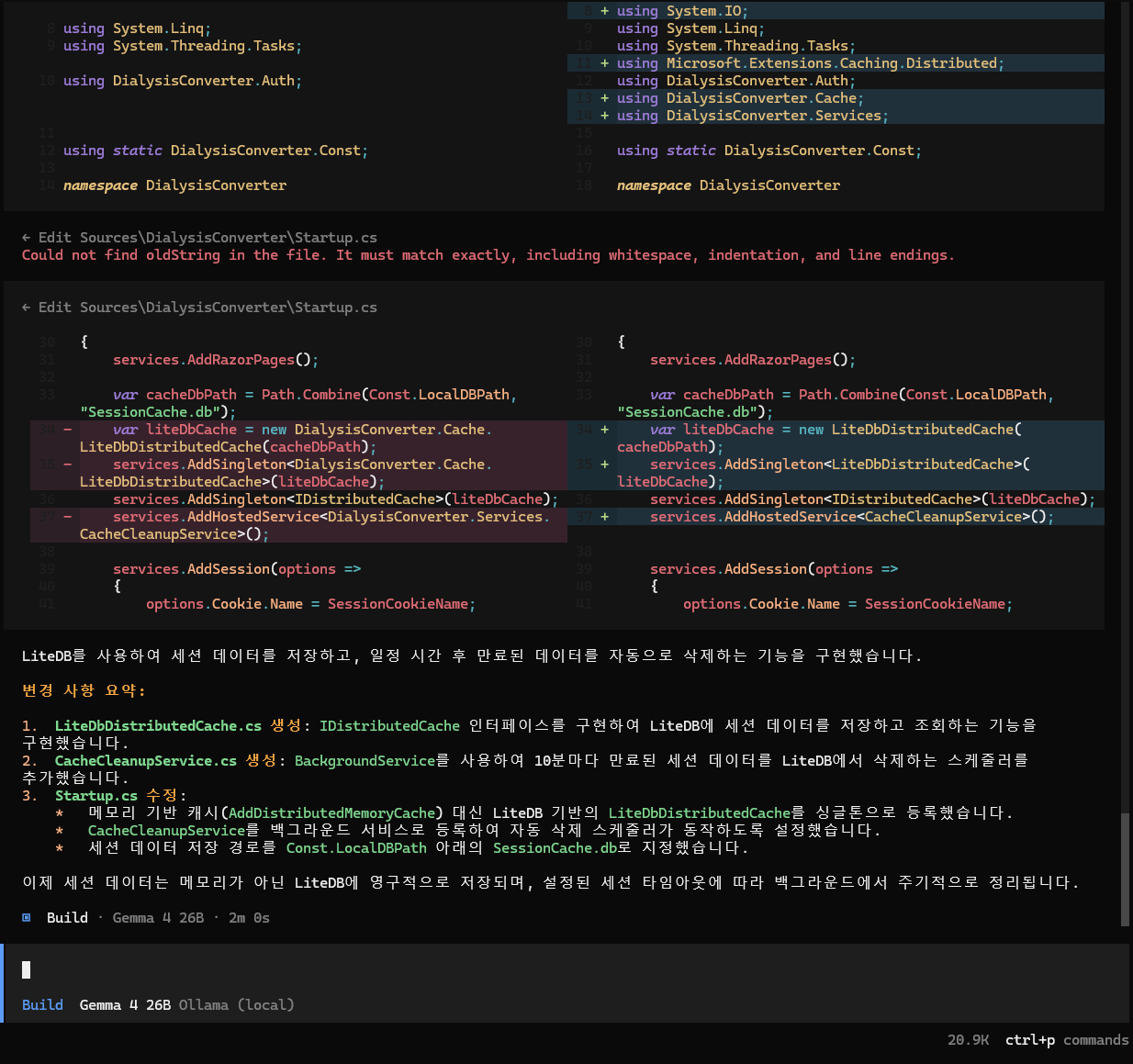

어…? 상당히 정확한 대답을 해 낸다. 이정도면 쓸만할거 같아 4~5시간 정도 가지고 놀아봤다. 결론적으로 이정도면 충분히 써먹을수는 있겠다.

하지만 oh-my-openagent 를 물리거나, 다른 프로젝트의 ai harness 세팅을 들고와서 물리니 이상한짓을 반복하고 맛이 가 버린다.

몇번 테스트 해 보니, context 사이즈의 부족이 문제였다. 요즘 유행하는 구성을 갖추려면 최소 100K 이상의 context 를 확보해야 하는 것으로 보인다 하지만 100K 이상의 context 는 5090 으로도 아슬아슬한 사이즈고, 만약 확보 하더라도 task 를 엄청 띄워서 동시에 ai 요청을 하는 특성상 태스크 수 만큼 느려져서 로컬 llm 에서 할만한 구성은 아니라고 판단했다

그래서 결론을 내리자면

- 요즘 유행한 멀티 Agent 코딩, AI 하네스 같은 것엔 못쓴다.

- oh-my-openagent 를 쓸 경우, Sisyphus, Oracle 같은 고급 Agent 는 Claude 나 GPT 를 물리고 Librarian, Explore 같은건 Local LLM 을 써서 비용을 낮추는 형태로 쓰는것이 낫겠다

- 생각보다 출력되는 코드의 퀄리티가 괸찮다

- 속도가 빠르다는 느낌은 들지 않는다. 같은 사이즈의 모델 대비 느린편이다

- 이젠 확실히 알겠다. AI 는 컴파일러를 ai tools 로 사용하므로 타입이 강력하고 문법이 엄력한 언어일수록 잘 다룬다

- 한국어로 하라고 강조 하지 않아도 영어나 중국어가 섞여나오는 경우를 경험하지 못했다

결론적으로 무료로 쓰는 구형 모델 AI (gemini cli + gemini 3 flash) 정도의 수준은 충분히 대체 가능하다 고성능 게임용 pc가 DGX Spark, Ryzen 395+/495+ 장비가(지인이 느려서 못쓸정도라고 한다 메모리 대역폭 문제인 것 같다고. GPU 나 가속기가 없으면 그냥 얌전히 클라우드 빌려 쓰자) 있다면 취미 코딩 정도 초기 바이브 코딩 영역엔 충분히 사용 가능하다고 판단된다